Work by AI – Prompt Engineering [UPDATED]

Prompt Engineering: Effektive Prompts für präzise KI-Ergebnisse

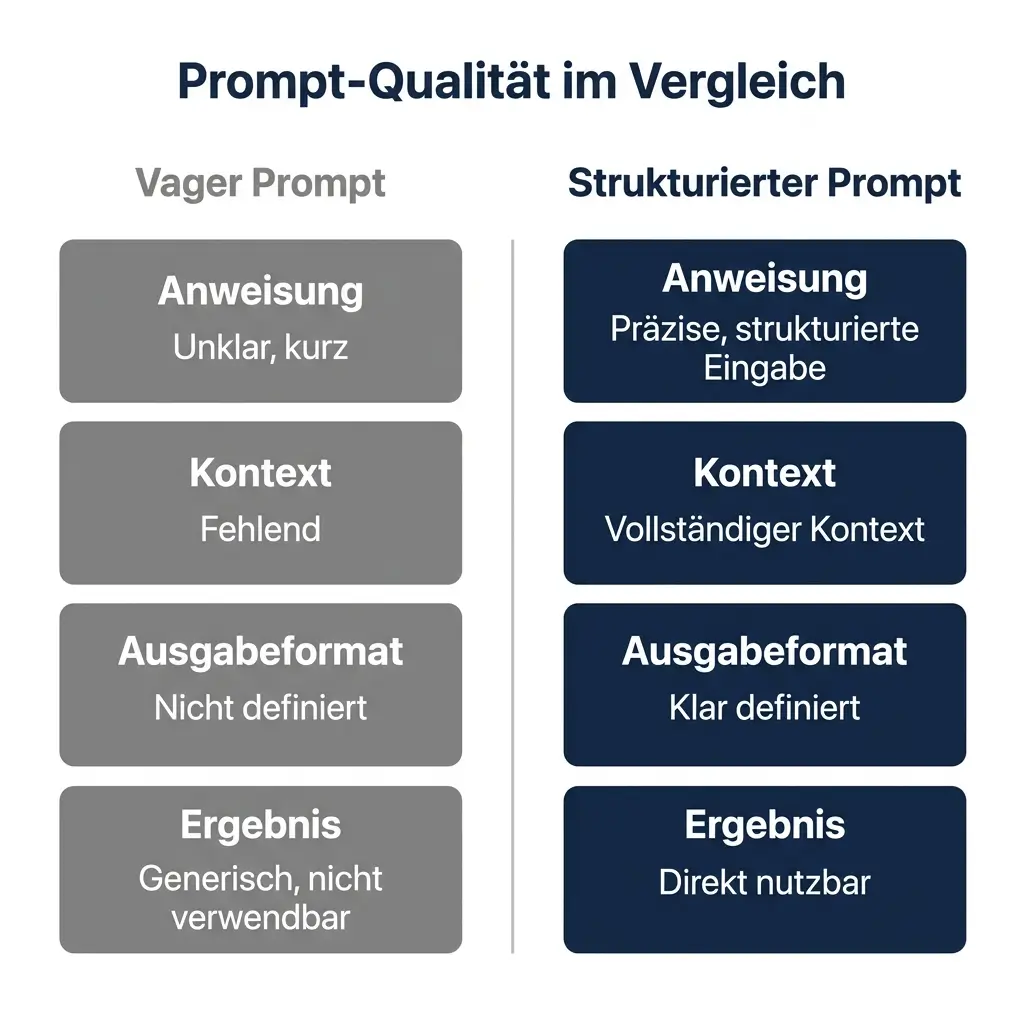

Prompt Entwicklung entscheidet darüber, ob eine KI brauchbare Arbeitsergebnisse liefert oder nur hübsch formulierte Texte ohne Substanz. Wer mit ChatGPT 5, Claude Opus 4.7, Gemini oder anderen Large Language Models arbeitet, kennt das Problem: Die Antwort klingt plausibel, lässt sich aber nicht verwenden. Nicht weil das KI-Modell schlecht wäre, sondern weil die Anweisung zu vage, zu offen oder schlicht unvollständig war. Professionelles Prompt Engineering setzt genau hier an. Es verwandelt allgemeine KI-Antworten in belastbare Ergebnisse, die sich direkt im Arbeitsalltag einsetzen lassen.

Professionelle Prompt-Entwicklung für Ihren Arbeitsalltag

Sie brauchen keine KI-Theorie. Sie brauchen Prompts, die funktionieren. Prompts, die aus Rohdaten einen verwertbaren Report machen, aus Kundenanfragen eine strukturierte Auswertung oder aus internen Dokumenten eine saubere Zusammenfassung. Work by AI entwickelt genau solche Prompts: getestet, nachgeschärft und auf Ihre Prozesse abgestimmt.

Der Unterschied zu einem selbst geschriebenen Prompt liegt nicht in der ersten Formulierung. Er liegt im systematischen Testen, im Prüfen mit unterschiedlichen Eingaben und im Absichern gegen unerwünschte Ausgaben. Ein Prompt, der bei einem Beispiel funktioniert, scheitert häufig am nächsten. Professionelle Prompt-Entwicklung stellt sicher, dass die Ergebnisse stabil bleiben, egal welche Daten hineinfließen.

Warum liefern KI-Modelle oft unbrauchbare Ergebnisse?

Viele Unternehmen starten mit hohen Erwartungen an künstliche Intelligenz. Sie testen ChatGPT 5, Claude oder Gemini, formulieren eine Frage und erhalten eine Antwort, die auf den ersten Blick gut aussieht. Beim genaueren Hinsehen fehlen Details, die Struktur passt nicht zum gewünschten Format und einzelne Aussagen lassen sich nicht belegen. Die Enttäuschung führt oft zu einem vorschnellen Urteil: Die KI taugt nichts für unsere Aufgaben.

Dabei liegt das Problem selten beim Modell selbst. Generative KI-Modelle wie ChatGPT 5, Claude Opus 4.7 oder Gemini sind leistungsfähig, doch sie brauchen präzise Anweisungen, um relevante Ergebnisse zu liefern. Ohne klare Zieldefinition, ohne Kontext und ohne Angaben zum gewünschten Ausgabeformat raten diese Systeme. Und raten führt zu Ergebnissen, die zwar sprachlich korrekt klingen, inhaltlich aber am Ziel vorbeigehen.

Wenn der Prompt das Problem ist und nicht das Sprachmodell

Ein typisches Beispiel: Sie bitten eine KI, ein Angebot zusammenzufassen. Ohne weitere Angaben liefert das Modell eine allgemeine Zusammenfassung, die weder die relevanten Preispositionen hervorhebt noch das gewünschte Format einhält. Dasselbe Modell liefert mit einem sauber formulierten Prompt eine strukturierte Tabelle mit Positionen, Preisen und Bewertungskriterien. Gleiche KI, gleiches Sprachmodell, völlig anderes Ergebnis.

Dieses Muster zieht sich durch jeden Einsatzbereich. Ob Datenextraktion, Content-Erstellung oder automatisierte Analysen: Die Qualität der Ausgabe hängt direkt von der Qualität des Prompts ab. Wer die Anweisung nicht sauber formuliert, bekommt bestenfalls Mittelmaß. Die KI ist so gut wie ihr Prompt.

Was ist Prompt Engineering?

Prompt Engineering beschreibt den systematischen Prozess, Anweisungen für KI-Systeme so zu entwickeln, dass die ki präzise und verwertbare Ergebnisse liefert. Es geht nicht darum, eine clevere Frage zu formulieren. Es geht darum, dem Modell exakt mitzuteilen, was es tun soll, in welchem Kontext es arbeitet, welches Format die Ausgabe haben muss und welche Regeln dabei gelten.

Die Disziplin verbindet Elemente aus Computerlinguistik, maschinellem Lernen und praktischem Prozessverständnis. Prompt Engineering ist keine Programmierung im klassischen Sinn, auch wenn manche Prompts an Code erinnern. Es ist eher eine präzise Form der Kommunikation zwischen Mensch und Maschine, bei der jedes Wort zählt.

Was ist ein Prompt im KI-Kontext?

Ein Prompt ist die Eingabe, die ein Nutzer an ein KI-Modell schickt. Das kann eine einfache Frage sein, eine mehrstufige Anweisung oder ein komplexes Template mit Platzhaltern, Regeln und Qualitätskriterien. Bei Large Language Models wie ChatGPT verarbeitet das Modell den Prompt über Tokenisierung, zerlegt die Eingabe also in kleine Einheiten und generiert darauf basierend eine Antwort.

Je klarer und strukturierter der Prompt, desto vorhersagbarer das Ergebnis. Ein Prompt kann wenige Wörter umfassen oder mehrere Seiten lang sein. Entscheidend ist nicht die Länge, sondern ob alle relevanten Informationen enthalten sind: Ziel, Kontext, Eingabedaten, gewünschtes Format und Einschränkungen.

Welche Rolle spielt Prompt Engineering bei generativen KI-Modellen?

Generative KI-Modelle erzeugen Inhalte, statt sie nur zu klassifizieren oder zu sortieren. Ein generatives Modell kann Texte schreiben, Daten zusammenfassen, Analysen erstellen oder Vorschläge generieren. Tools wie ChatGPT 5, Claude Opus 4.7, Gemini oder DALL-E 3 arbeiten alle auf Basis solcher generativer Modelle, bei denen der Prompt die zentrale Steuerungsebene darstellt.

Ohne Prompt Engineering arbeiten diese KI-Systeme mit Standardannahmen. Sie füllen Lücken in der Anweisung mit statistischen Wahrscheinlichkeiten, was zu generischen Ausgaben führt. Prompt Engineering ersetzt dieses Raten durch klare Vorgaben. Es gibt dem Modell einen Rahmen, innerhalb dessen es arbeiten soll, und definiert, was ein gutes Ergebnis ausmacht. Das ist besonders relevant bei fachlichen Anwendungen, wo allgemeine Antworten schlicht nicht ausreichen.

Warum ist professionelles Prompt Engineering wichtig?

Die meisten Unternehmen nutzen KI bisher nur oberflächlich. Ein Chatbot für allgemeine Fragen, ein Textgenerator für erste Entwürfe, vielleicht ein Zusammenfassungstool. Das volle Potenzial bleibt ungenutzt, weil die Prompts nicht auf die spezifischen Aufgaben abgestimmt sind. Professionelles Prompt Engineering schließt diese Lücke.

Wer Prompts systematisch entwickelt, spart bei jeder einzelnen Nutzung Zeit. Ein Mitarbeiter, der täglich Reports aus Rohdaten erstellt, verbringt ohne funktionierenden Prompt jedes Mal zehn bis fünfzehn Minuten mit Nacharbeit. Mit einem sauber entwickelten Prompt reduziert sich dieser Aufwand auf Sekunden. Hochgerechnet auf Wochen und Monate ergibt das einen spürbaren Unterschied für das gesamte Unternehmen.

Vorteile von Prompt Engineering für Unternehmen

Der offensichtlichste Vorteil: bessere Ergebnisse bei weniger Aufwand. Doch es steckt mehr dahinter. Professionell entwickelte Prompts machen KI-Anwendungen reproduzierbar. Wenn jeder Mitarbeiter eigene Prompts formuliert, schwankt die Qualität der Ergebnisse erheblich. Standardisierte Prompts sorgen dafür, dass die Ausgaben konsistent bleiben.

Ein weiterer Vorteil betrifft die Interaktion mit KI-Systemen insgesamt. Unternehmen, die ihre Prompts systematisch entwickeln und pflegen, bauen internes Wissen auf. Sie verstehen, was die KI leisten kann und wo ihre Grenzen liegen. Das schützt vor falschen Erwartungen und ermöglicht eine realistische Einschätzung, welche Prozesse sich effektiv automatisieren lassen. Gute Prompts sind damit auch ein Werkzeug für bessere Entscheidungen rund um den KI-Einsatz.

Welche Arten von Prompts gibt es?

Prompts lassen sich nach ihrer Struktur und dem Umfang der mitgelieferten Informationen unterscheiden. Je nach Aufgabe und Komplexität eignen sich unterschiedliche Ansätze. Die Wahl des richtigen Prompt-Typs beeinflusst direkt, wie gut das KI-Modell die gewünschte Aufgabe löst.

Zero-Shot, Few-Shot und Chain-of-Thought Prompts

Bei einem Zero-Shot-Prompt erhält das Modell eine Aufgabe ohne Beispiele. Das funktioniert bei einfachen Anfragen gut, stößt aber bei fachlichen oder strukturierten Ausgaben schnell an Grenzen. Few-Shot-Prompts liefern dem Modell ein oder mehrere Beispiele mit, sodass es das gewünschte Muster erkennt und reproduziert. Diese Technik eignet sich besonders für wiederkehrende Aufgaben mit festem Ausgabeformat.

Chain-of-Thought-Prompts gehen einen Schritt weiter. Hier wird das Modell angewiesen, seinen Denkprozess schrittweise offenzulegen, bevor es zum Ergebnis kommt. Das verbessert die Genauigkeit bei komplexen Aufgaben wie Analysen, Berechnungen oder mehrstufigen Auswertungen erheblich. In der Praxis kombinieren professionelle Prompts häufig mehrere dieser Techniken, um die bestmöglichen Ergebnisse zu erzielen.

Strukturierte Prompts für fachliche KI-Anwendungen

Für den Einsatz in Unternehmen reicht ein einfacher Satz als Prompt selten aus. Strukturierte Prompts enthalten klar definierte Abschnitte: eine Rollenbeschreibung für das Modell, den Kontext der Aufgabe, die Eingabedaten, das gewünschte Ausgabeformat und explizite Regeln, was das Modell tun oder lassen soll. Diese Prompts ähneln einer detaillierten Arbeitsanweisung.

Ein Beispiel aus der Praxis: Ein Prompt für die automatisierte Angebotsauswertung enthält das Bewertungsschema, die relevanten Kriterien, das Ausgabeformat als Tabelle und die Regel, dass das Modell keine eigenen Bewertungskriterien ergänzen darf. Solche strukturierten Prompts generieren Ergebnisse, die sich direkt in bestehende Workflows einfügen, ohne manuelle Nacharbeit.

Was macht gute Prompts aus?

Ein guter Prompt ist kein Zufallsprodukt und auch kein kreativer Einfall. Er ist das Ergebnis systematischer Arbeit. Gute Prompts zeichnen sich dadurch aus, dass sie mit unterschiedlichen Eingaben stabile, verwertbare Ergebnisse liefern. Sie sind präzise genug, um das Modell zu führen, und flexibel genug, um verschiedene Datensätze zu verarbeiten.

Klare Zieldefinition, Kontext und Qualitätskriterien

Jeder effektive Prompt beginnt mit einer klaren Zieldefinition. Was soll das Ergebnis sein? Für wen ist es bestimmt? Welche Informationen stehen zur Verfügung? Ohne diese Grundlagen produziert das Modell Ausgaben, die zwar sprachlich korrekt sind, aber am Bedarf vorbeigehen.

Der Kontext gibt dem Modell den nötigen Rahmen. Arbeitet es als Analyst, als Texter oder als Datenverarbeiter? Je klarer die Rolle definiert ist, desto passender fällt die Antwort aus. Qualitätskriterien ergänzen diesen Rahmen um messbare Anforderungen: maximale Textlänge, gewünschte Sprache, Formatierungsvorgaben oder inhaltliche Einschränkungen. Diese drei Elemente bilden das Fundament jedes professionellen Prompts.

Strukturierte Ausgaben für verwertbare Ergebnisse

Ein häufig unterschätzter Faktor ist das Ausgabeformat. Wer dem Modell nicht sagt, wie das Ergebnis aussehen soll, erhält Fließtext. In vielen Anwendungsfällen brauchen Sie aber eine Tabelle, eine nummerierte Liste, ein JSON-Objekt oder eine klar gegliederte Analyse mit Zwischenüberschriften.

Strukturierte Ausgaben machen KI-Ergebnisse direkt verwertbar. Sie lassen sich in bestehende Systeme einspeisen, von anderen Tools weiterverarbeiten oder ohne Umformatierung an Kollegen weiterleiten. Wer Prompts für Automatisierungen entwickelt, muss das Ausgabeformat von Anfang an mitdenken. Ein Prompt, der schöne Texte generiert, aber kein maschinenlesbares Format liefert, ist für einen automatisierten Workflow wertlos.

Wie funktioniert Prompt Engineering in der Praxis?

Theorie hilft beim Verständnis. Doch der eigentliche Wert von Prompt Engineering zeigt sich im konkreten Einsatz. Die folgenden Beispiele illustrieren, wie professionell entwickelte Prompts in realen Geschäftsprozessen arbeiten und warum der Unterschied zu ad-hoc formulierten Anweisungen so deutlich ausfällt.

Beispiele für Prompt Engineering bei Analysen und Reports

Ein mittelständisches Unternehmen erhält wöchentlich Vertriebsdaten aus drei verschiedenen Quellen. Bisher wertet ein Mitarbeiter diese Daten manuell aus und erstellt einen Zusammenfassungsbericht. Mit einem professionell entwickelten Prompt übernimmt die KI diese Aufgabe: Sie erhält die Rohdaten, analysiert Abweichungen zum Vormonat, identifiziert die drei wichtigsten Veränderungen und formuliert den Report im vorgegebenen Format.

Der Prompt definiert dabei exakt, welche Kennzahlen relevant sind, wie Abweichungen bewertet werden und in welcher Reihenfolge die Ergebnisse erscheinen sollen. Das Modell generiert so bei jeder Ausführung einen Report, der inhaltlich konsistent und formal einheitlich ist. Statt einer halben Stunde Nacharbeit bleibt nur noch eine kurze Plausibilitätsprüfung.

Beispiele für Content-Erstellung und Datenextraktion

Bei der Content-Erstellung zeigt sich der Unterschied zwischen einem selbst geschriebenen und einem professionellen Prompt besonders deutlich. Ein allgemeiner Prompt wie „Schreibe einen Blogartikel über Thema X

Bereit für Prompts, die wirklich funktionieren?

Work by AI entwickelt, testet und dokumentiert Prompts, die in Ihren Prozessen stabil und reproduzierbar funktionieren. Starten Sie mit einem kostenlosen Erstgespräch.